Platforma Obywatelska opublikowała wczoraj spot, w którym zestawiła kilka wypowiedzi premiera Mateusza Morawieckiego ze zdaniami mającymi rzekomo pochodzić z wiadomości przejętych przez hakerów ze skrzynki ministra Michała Dworczyka. Fragmenty te czyta sam premier Mateusz Morawiecki, ponieważ Platforma wygenerowała jego głos w technologii deepfake za pomocą Sztucznej Inteligencji. Dopiero kilka godzin po publikacji spotu politycy opublikowali dopisek, w którym przyznali, że „lektor (został – red.) wygenerowany przez AI”. W ten sposób PO stworzyła u odbiorców wrażenie, że rzeczywiście słyszą wypowiedź szefa rządu.

Jak tak naprawdę wyglądają relacje w „zjednoczonej” prawicy? Przekonajcie się sami! #MailePrawdy pic.twitter.com/ehytYIqwKf

— PlatformaObywatelska (@Platforma_org) August 24, 2023

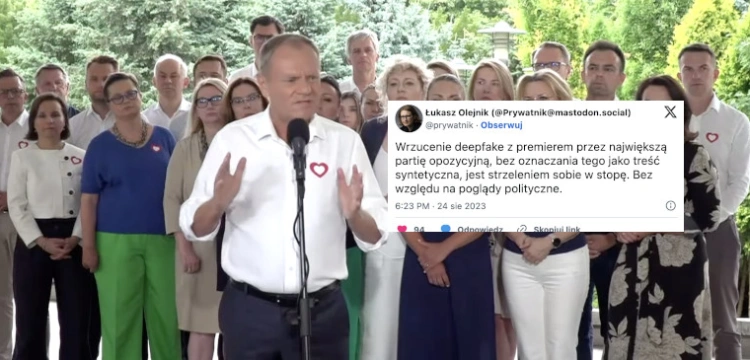

- „Wrzucenie deepfake z premierem przez największą partię opozycyjną, bez oznaczania tego jako treść syntetyczna, jest strzeleniem sobie w stopę. Bez względu na poglądy polityczne”

- podkreśla w mediach społecznościowych dr Łukasz Olejnik, ekspert w zakresie cyberbezpieczeńśtwa.

Wrzucenie deepfake z premierem przez największą partię opozycyjną, bez oznaczania tego jako treść syntetyczna, jest strzeleniem sobie w stopę. Bez względu na poglądy polityczne.

— Łukasz Olejnik (@Prywatnik@mastodon.social) (@prywatnik) August 24, 2023

- „Nieładnie. Treści wygenerowane przez AI powinny być oznaczone, a szczególnie już takie jak te”

- napisał z kolei publikujący na temat Sztucznej Inteligencji Michał Podlewski.

Nieładnie.

— Michał Podlewski (@TrajektoriaAI) August 24, 2023

Treści wygenerowane przez AI powinny być oznaczone, a szczególnie już takie jak te.

🧵Nitka: Info + przykłady technologii👇#genai #deepfake #wygenerowaneprzezAIhttps://t.co/uHc9Ta2CoC

Głos zabrała również prof. Aleksandra Przegalińska-Skierkowska.

- „Uważałabym jednakowoż, że kiedy powstaje klon głosu, to należy to oznaczać w samym poście, żeby było jasne, że to nagranie powstało z wykorzystaniem AI. Trzymajmy się najlepszych standardów w dobie generatywnej sztucznej inteligencji”

- napisała badaczka rozwoju nowych technologii.

Uważałabym jednakowoż, że kiedy powstaje klon głosu to należy to oznaczać w samym poście, żeby było jasne, ze to nagranie powstało z wykorzystaniem AI. Trzymajmy się najlepszych standardów w dobie generatywnej sztucznej inteligencji #AI. https://t.co/o5RLNHNwXi

— ᴘʀᴏꜰ. ᴀʟᴇᴋꜱᴀɴᴅʀᴀ ᴘʀᴢᴇɢᴀʟɪɴꜱᴋᴀ (@Przegaa) August 24, 2023

Platforma Obywatelska nic nie robi sobie jednak z krytyki i dalej dezinformuje. Dziś rano opublikowała kolejny spot, choć tym razem zaznaczając w opisie (nie samym nagraniu), że wykorzystano AI.

Jeden mail może załatwić pracę w ministerstwie? Posłuchaj, jak się robi karierę w państwie PiS od kulis! 🎥Przedstawiamy kolejny odcinek z serii #MailePrawdy❗

— PlatformaObywatelska (@Platforma_org) August 25, 2023

[Lektor wygenerowany przez AI] pic.twitter.com/bwsWfGKeJg

![[Wideo] „Hazarskie michnikowe stado cyngli, bezmózgowi aktorzy…” - Wojciech Reszczyński nie gryzł się w język](https://cdn.fronda.pl/imgcache/262x147/c/uploads/news/reszczynski-yt-bk-1780919515.jpg)